Qwen2.5 Math 1.5B

par Qwen

Open source · 411k downloads · 105 likes

2.5

(105 avis)ChatAPI & LocalÀ propos

Le modèle Qwen2.5 Math 1.5B est une intelligence artificielle spécialisée dans la résolution de problèmes mathématiques en anglais et en chinois. Il combine deux approches de raisonnement : le *Chain-of-Thought* (CoT) pour des explications détaillées et le *Tool-integrated Reasoning* (TIR) pour des calculs précis et des manipulations symboliques, comme la résolution d'équations ou le calcul de matrices. Ses performances surpassent celles de son prédécesseur, notamment sur des benchmarks mathématiques exigeants, tout en restant accessible pour des tâches de base ou d'inférence en few-shot. Destiné principalement aux applications éducatives, scientifiques ou techniques nécessitant une rigueur mathématique, il se distingue par sa polyvalence linguistique et sa capacité à gérer des raisonnements complexes. Son format léger (1,5 milliard de paramètres) le rend adapté aux environnements où les ressources sont limitées, tout en offrant une base solide pour des adaptations ou des entraînements supplémentaires.

Documentation

Qwen2.5-Math-1.5B

[!Warning]

🚨 Qwen2.5-Math mainly supports solving English and Chinese math problems through CoT and TIR. We do not recommend using this series of models for other tasks.

Introduction

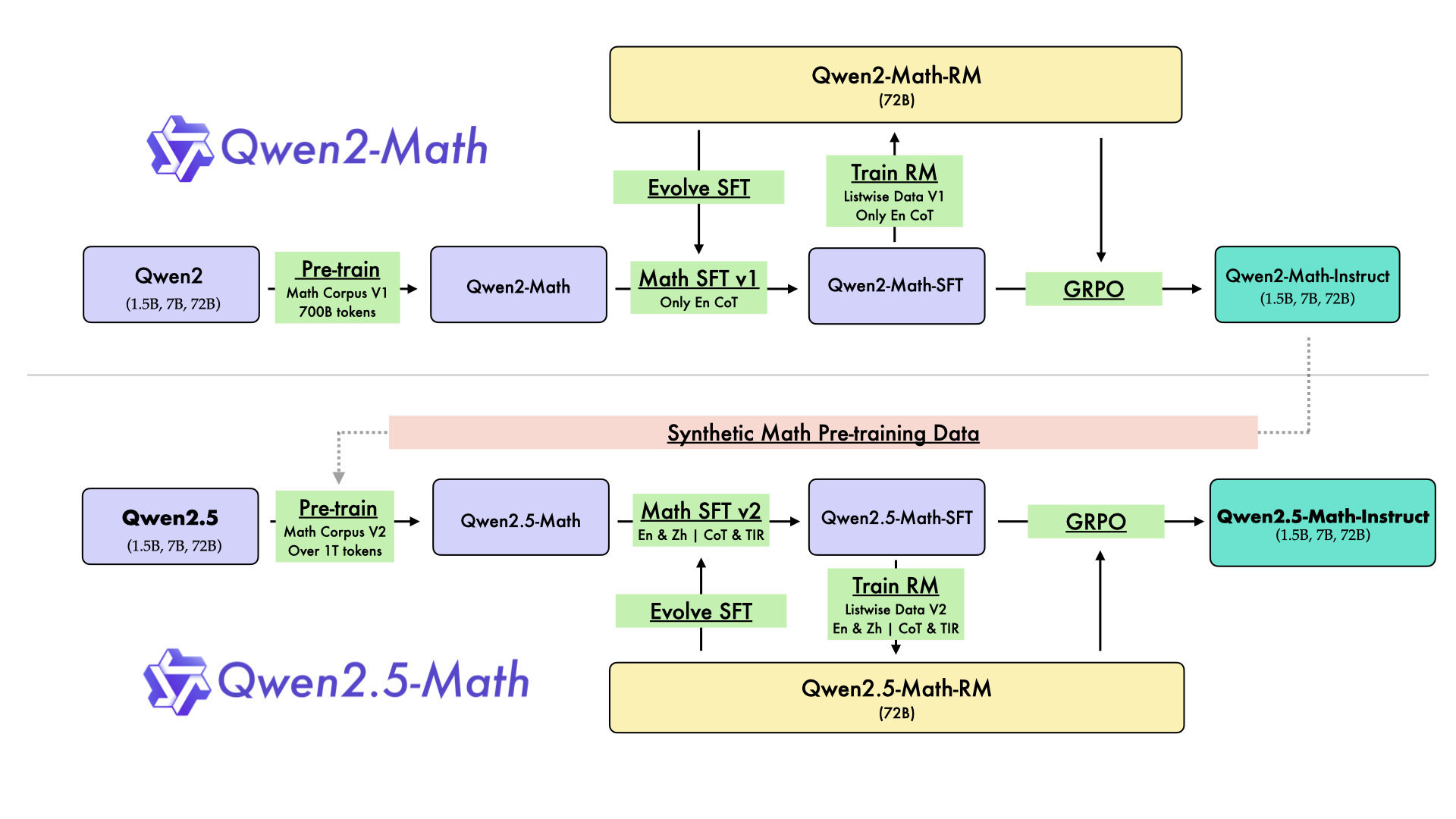

In August 2024, we released the first series of mathematical LLMs - Qwen2-Math - of our Qwen family. A month later, we have upgraded it and open-sourced Qwen2.5-Math series, including base models Qwen2.5-Math-1.5B/7B/72B, instruction-tuned models Qwen2.5-Math-1.5B/7B/72B-Instruct, and mathematical reward model Qwen2.5-Math-RM-72B.

Unlike Qwen2-Math series which only supports using Chain-of-Thught (CoT) to solve English math problems, Qwen2.5-Math series is expanded to support using both CoT and Tool-integrated Reasoning (TIR) to solve math problems in both Chinese and English. The Qwen2.5-Math series models have achieved significant performance improvements compared to the Qwen2-Math series models on the Chinese and English mathematics benchmarks with CoT.

While CoT plays a vital role in enhancing the reasoning capabilities of LLMs, it faces challenges in achieving computational accuracy and handling complex mathematical or algorithmic reasoning tasks, such as finding the roots of a quadratic equation or computing the eigenvalues of a matrix. TIR can further improve the model's proficiency in precise computation, symbolic manipulation, and algorithmic manipulation. Qwen2.5-Math-1.5B/7B/72B-Instruct achieve 79.7, 85.3, and 87.8 respectively on the MATH benchmark using TIR.

Model Details

For more details, please refer to our blog post and GitHub repo.

Requirements

transformers>=4.37.0for Qwen2.5-Math models. The latest version is recommended.

[!Warning]

🚨 This is a must becausetransformersintegrated Qwen2 codes since4.37.0.

For requirements on GPU memory and the respective throughput, see similar results of Qwen2 here.

Quick Start

[!Important]

Qwen2.5-Math-1.5B-Instruct is an instruction model for chatting;

Qwen2.5-Math-1.5B is a base model typically used for completion and few-shot inference, serving as a better starting point for fine-tuning.

Citation

If you find our work helpful, feel free to give us a citation.

INI

@article{yang2024qwen25mathtechnicalreportmathematical,

title={Qwen2.5-Math Technical Report: Toward Mathematical Expert Model via Self-Improvement},

author={An Yang and Beichen Zhang and Binyuan Hui and Bofei Gao and Bowen Yu and Chengpeng Li and Dayiheng Liu and Jianhong Tu and Jingren Zhou and Junyang Lin and Keming Lu and Mingfeng Xue and Runji Lin and Tianyu Liu and Xingzhang Ren and Zhenru Zhang},

journal={arXiv preprint arXiv:2409.12122},

year={2024}

}

Liens & Ressources